Occorre avviare un nuovo modello di contrattazione: “la contrattazione collettiva sui sistemi algoritmici, perché qui sono in gioco condizioni base: orari, salari, organici, carriere, sicurezza e salute, stabilità occupazionale“.

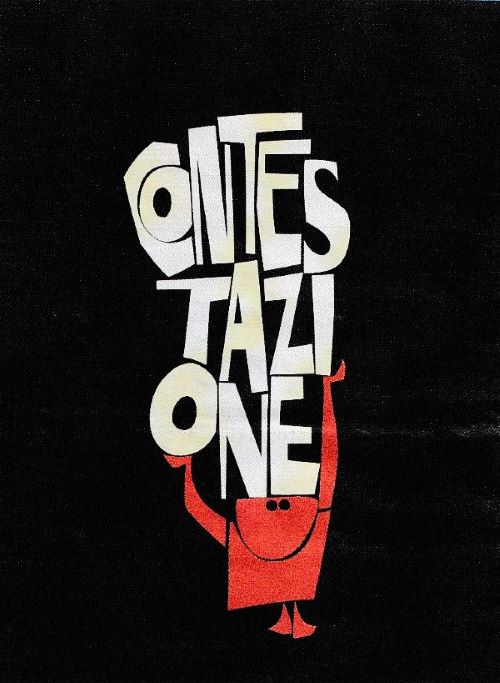

Impedire “adozione unilaterale di strumenti che incidono su tempi, retribuzioni, mansioni”. Negoziare “valutazioni d’impatto sull’organizzazione del lavoro“. Garantire “accesso sindacale agli algoritmi“, con il diritto di “fermare o rimodulare i sistemi che generano discriminazioni, intensificazione del lavoro o rischi per la salute”. E’ una strada percorribile? In assenza di un forte movimento sindacale non c’è il rischio che tutto si trasformi nella costruzione di una macchina del consenso attraverso la “coopartecipazione”?. Forse si può iniziare dal rifiuto, che contenga anche l’ipotesi del sabotaggio

******************************************

Con l’esclusione del lavoro vivo l’algoritmo dell’AI è improduttivo

E se il vero problema dell’Intelligenza artificiale nelle imprese fosse il modo in cui la stanno introducendo? Un nuovo rapporto legato al Mit mostra che il 95% dei “pilot” di intelligenza artificiale non produce impatti misurabili sulla produttività. Non solo perché i modelli “non funzionano”, ma perché vengono calati dall’alto, senza entrare davvero nel lavoro vivo e nei processi quotidiani.

Una delle possibili spiegazioni è che manager e programmatori non conoscono il lavoro come le lavoratrici e i lavoratori. Il lavoro reale è fatto di eccezioni, saperi taciti, micro-decisioni e compromessi operativi che nessuna soluzione calata dall’alto può catturare. Quando l’AI arriva come un software “chiavi in mano”, rischia di irrigidire i flussi, aumentare la burocrazia digitale e fermarsi nel purgatorio dei progetti pilota.

C’è però un’altra strada, documentata da ricerche comparate: coinvolgere la voce del lavoro, ex ante. Un nuovo Working Paper dell’ILO curato da Virginia Doellgast mostra casi da tutto il mondo in cui dialogo sociale e contrattazione collettiva hanno riorientato l’AI dal sostituire al “complementare” il lavoro, dal controllo all’empowerment, dallo spiazzare all’incardinare le innovazioni dentro tutele e percorsi di riqualificazione. Dove esistono organismi rappresentativi, regole sul confronto e vincoli all’“uscita” datoriale (automazione/esternalizzazione), l’AI rende di più, con meno conflitti e più qualità.

Tutto questo è cruciale anche perché finora abbiamo puntato quasi solo sulla privacy. Ma il cuore dell’“algorithmic management” non è (solo) il trattamento dei dati: è l’estensione e l’opacizzazione dei poteri datoriali su assunzioni, assegnazione dei turni, intensità e tempi di lavoro, sorveglianza, valutazioni, premi e sanzioni, fino ai licenziamenti automatizzati. Se riduciamo tutto al consenso e all’informativa sui dati personali, lasciamo intatto l’impianto di comando. Servono regole che riequilibrino il potere, garantendo trasparenza funzionale (come e per che cosa si usa l’AI), verificabilità delle decisioni, diritto di contestazione e co-progettazione dei sistemi con chi il lavoro lo fa.

In questo quadro, il Parlamento europeo discuterà una proposta di direttiva sull’algorithmic management. È un passo avanti importante: riconosce che gli strumenti algoritmici organizzano, monitorano e valutano il lavoro. Ma perché la direttiva sia all’altezza della situazione, la politica deve riconoscere che la sola privacy non basta. Occorre spostare l’asse dall’“informazione e consultazione” (che lascia l’ultima parola all’impresa) alla contrattazione collettiva sui sistemi algoritmici, perché qui sono in gioco condizioni base: orari, salari, organici, carriere, sicurezza e salute, stabilità occupazionale.

In concreto: nessuna adozione unilaterale di strumenti che incidono su tempi, retribuzioni, mansioni; valutazioni d’impatto sull’organizzazione del lavoro negoziate e trasparenti; accesso sindacale agli algoritmi (logiche decisionali, soglie, dati usati) e test pilota dell’adozione di nuovi sistemi; diritto a fermare o rimodulare i sistemi che generano discriminazioni, intensificazione del lavoro o rischi per la salute; percorsi di riqualificazione garantiti e finanziati quando l’automazione cambia le mansioni. Questo non “frena l’innovazione”: la orienta verso produttività di qualità e consenso sociale, come mostrano i casi raccolti dall’ILO.

L’Europa e l’Italia possono scegliere: continuare a chiedersi come deregolamentare ancora di più la tecnologia a vantaggio di progetti-vetrina che gonfiano slide e bilanci ma non funzionano, o fare dell’AI un terreno di democrazia industriale. La seconda via non richiede miracoli: chiede tempo di progettazione condiviso, istituzioni della partecipazione (RSU, RLS, comitati congiunti su dati e algoritmi), contratti che definiscano scopi, limiti e responsabilità. È la via che riduce il rischio di fallire come in quel 95% di progetti pilota, e che restituisce all’AI la sua promessa: potenziare il lavoro, non sostituirlo; migliorare la qualità, non comprimere diritti.

Se davvero si crede che l’innovazione debba servire alla società, coinvolgere chi lavora non è un orpello: è quello che rende la tecnologia davvero “intelligente”. La politica europea ha l’occasione – ora – di scriverlo nero su bianco. Sta a tutti noi pretenderlo

Valerio De Stafano, il manifesto, 20 agosto 2025